松果财经

松果财经21世纪什么最贵?大多数公司始料未及,最贵的原来是算力,是数万美元也“一芯难求”的GPU。

OpenAI创始人Sam Altman曾经预言,算力将成为一种新的货币。去年,Gartner预测2026年的全球AI支出预计将达到2.52万亿美元,其中光是基础设施就需要增加4010亿美元的投入,相当于英伟达三年多的营收。

算力的花费可以分为两部分,训练曾经是最昂贵的支出。但随着大模型嵌进搜索、广告、推荐、客服、游戏等高频场景,推理逐渐取代训练,占据更大的成本。IDC预计,2026年,推理算力的消耗占比将会提升到62.2%,训练算力则降低到37.8%。

AI需要商业化,企业便需要更高性价比的算力,否则辛苦开拓的商业模式,最后全喂饱了英伟达。然而,GPU遵循的传统架构在执行运算时有不小的数据搬运成本,在大规模实时生成任务中会产生更多花费,并且制造成本也在不断上升。

于是,挑战者不断出现,并抛出新的想法:如果,我们不用GPU的架构呢?

一、寻找GPU之外的可能性

GPU诞生于图形渲染年代,并行运算能力突出,通用能力强。但这种多功能性用来支持AI,就成了历史包袱,难以满足Token边际成本持续降低的需求。

这是索罗斯“反身性”理论在算力领域的兑现:GPU“意外”适应了AI的需求,早期AI依赖GPU并助推后者市场扩大乃至绝对占有,然而当算力需求发展到一定阶段,GPU架构又限制了AI效率的提高。早期的选择也许只是那个时代的认知偏差,但它又造成了后来的因果循环,直到有新的架构能打破这种怪圈。

相比之下,非GPU路线能更好地针对AI需求做定制化,ASIC(专用集成电路)因此崛起。这条路上的知名企业数不胜数,华为、谷歌、博通、百度、寒武纪……无论采取何种架构、打造何种产品,都是为了AI的降本增效。

2025年11月,谷歌发布Gemini 3,性能跑赢了OpenAI被市场寄予厚望的GPT 5.1。Gemini 3基于谷歌自研芯片TPU训练,高盛推算其单位token推理成本下降约70%,在后发条件下追平了英伟达GB200 NVL72的成本。

去年,Anthropic便宣布要采用最多100万张TPU,11月又有消息称Meta考虑将部分AI基础设施迁移至谷歌TPU。就连英伟达股价,也因此受到影响。

但ASIC有一个天然短板:既然是定制,那么就难以匹配还在持续更新的AI算法和架构需求,而设计一个架构需要很长的周期,一旦算法变更,芯片就有可能过时。“芯模协同”,对于AI生态的构建意义重大。

去年的上海世界人工智能大会上,就有不少国产芯片厂商格外强调这一点。DeepSeek作为开源之光,也得到了国产芯片厂商的大力适配。其V4版本发布在即,很快又要接近适配节点。

既要高性能,又要强适配,有没有一种办法,能让芯片和数据算法更好地协同,高效适应模型的进化?

不仅有,而且还得到了英伟达的变相认可。

去年末,英伟达意外斥资约200亿美元,获得Groq知识产权的非独家授权,并将其主要人物一举收入囊中。

Groq由谷歌TPU早期团队成员创立,他们基于可重构数据流方法打造了LPU(Language Processing Unit,语言处理单元)产品,适配开源模型后展现的推理成本远低于GPU。

而几乎同一时间,“北京四大明星芯片公司”之一的清微智能,也基于可重构芯片(RPU)优势拿下超20亿元C轮融资,国家大基金二期、京能集团、京国瑞等多层级国资密集入场。我们从行业了解到,清微智能过去一年估值翻了三倍有余,接近190亿元,目前正在筹备Pre-IPO轮融资,为最终上市做准备。

“可重构数据流”为什么这么独特,能在大洋两岸同时受到超级资本们的认可甚至追捧?答案是架构——它不再以上下指令的通用处理器为中心,而是先看要处理的数据流长什么样,再让硬件围绕数据流去重构自己的电路拓扑。简单来说,软件定义硬件:

传统GPU存在“内存墙、效率墙、互联墙”问题,因为指挥数据的“旗手”和搬运数据的“员工”要不断地交流信息,徒增成本。ASIC方案把搬运流程变成了固定流水线,效率提高了,不过每次需求一改就要重新定制流水线。而RPU方案是根据数据算法的需求定义流水线,想要什么传送方式,便可以朝那个方向重构。

用清微智能创始人王博的比喻,这是在芯片里搭了一张充满“电子道岔”的铁路网。传统芯片是一条单线铁路,火车只能沿既定轨道跑;可重构数据流芯片则在每个节点都埋了道岔,今天把这些“小计算器”连成卷积流水线,明天又重连成注意力模块专用路径,执行完一段网络就擦除配置,十几纳秒内切成另一种拓扑。

本质上,它把程序驱动硬件变成数据驱动硬件,让数据在芯片内部节点之间直接流动,尽量少绕回显存排队。这对参数海量、访问模式高度规则的大模型尤其友好——每少绕一次路,背后都是成本曲线被向下拉了一段。

于是,算力产业拥有了一个具备差异化特征的“第二阵营”,尝试在蛮力堆砌GPU之外找出路。以清微智能为代表的创业公司,正在给大模型算力问题写出“第二解”。

二、太平洋两岸的可重构竞赛:清微智能领衔中国式创新

可重构的概念并不新鲜,重要的是它有了产业化的能力。Groq把语言推理抽象成LPU,适配开源模型后的推理效率一鸣惊人,SambaNova也在用RDU与整机方案做企业市场。

在这股潮流中,清微智能作为稀缺的新架构算力芯片企业,自然而然扮演了一个新角色:中国并非只能在GPU主线上做追随者,在刚刚打开的第二条算力支流上,我们拥有一支能拿得出手的本土队伍。它脱胎于清华大学微电子学院研究成果,如今正在为中国的芯模协同贡献力量。

在端侧,清微早期用TX5系列产品验证了这条路并非纸上谈兵。一颗工作功耗不到2毫瓦的语音芯片,让门锁、音箱、手机保持常年待机聆听状态;多款视觉与语音终端芯片被装进摄像头、手机、IoT设备里,累计出货超三千万颗。这些看似不起眼的产品,在较长的链路中完成了可重构架构的可靠性和工具链压力测试。

而真正让清微智能具备“爆棚”潜力的,是面向云端市场的TX8高算力芯片。它把“数据流+可重构”直接做到大面积裸片上,并配上一种不同于GPU的互联方式——C2C算力网格。

传统GPU集群的路径是“PCIe—网卡—交换机—网卡—PCIe”,每加一层节点就多一层延迟和拥塞。清微选择在芯片之间直接织网,让多卡互联更接近板上直连。这样一来,在千卡规模内可以削减大量昂贵交换机投资,同时把大模型训练/推理中最容易触顶的“互联墙”压薄一层。

搭载TX81的REX1032训推一体服务器,在同等功耗下可以承载万亿参数模型部署,单机跑DeepSeekR1/V3级别模型无需“缩水版”;整机方案测算下来,比同类GPU产品综合成本低约一半,能效比提升约三倍。

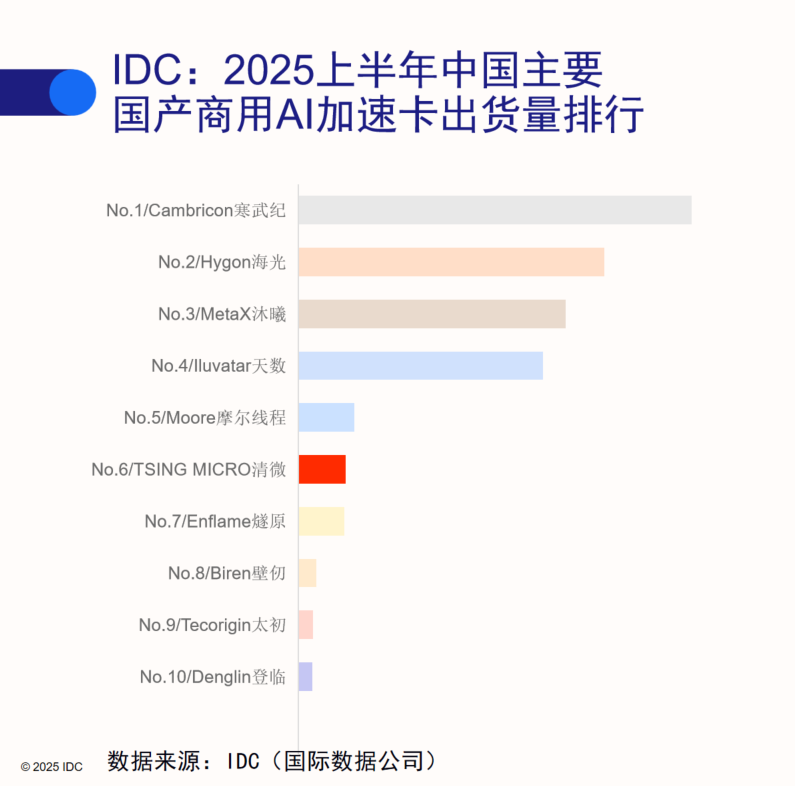

IDC统计显示,2025年上半年,清微在国产非GPU(含可重构、ASIC)加速卡销量中位列第六,进入本土算力第一梯队。

目前,清微智能已经为多地智算中心打造了“实战装备”。黑龙江、浙江、安徽、北京等地陆续上线千卡规模集群,新疆双河的中树云智算中心则在首期工程中直接采用可重构架构,成为“东数西算”和算力出海的重要节点之一。

在软件与生态上,清微一方面在众智FlagOS上做到卓越适配,与寒武纪、昆仑芯、摩尔线程、昇腾、中科海光并列为领域内的“六脉神剑”;另一方面采用“三层兼容”策略——上层CUDA API级兼容,中层深度押注OpenAI主推的Triton编译器并与智源共建生态,底层用RISC‑V替代PTX,为开发者预留足够“压榨性能”的空间。

这些看似琐碎的工程选择,针对的是新架构影响的客户迁移成本、交付与支持可靠性等问题。太多AI芯片创业公司倒在这一关,而清微智能在可重构数据流这条支流上,率先完成了从可用到可规模部署的跃迁,为中国算力产业探得了一方独立、有潜力的天地。

三、从“补课生”到“解题人”:高阶国产替代的第二条路

王博曾经表示,“相比短平快的仿制路线,选择新架构实现‘换道超车’才是真正的高阶国产替代。”清微智能押注未来3到5年的算力革命,实施“研发一代、储备一代、释放一代”的技术战略。

在这个过程中,清微智能扭转了算力问题的维度:不做英伟达的“补课生”,而是在另一条技术主线上,成为“解题人”。

这条路的难度一点不低,它意味着几件事要同时发生:

第一,要接受长时间的生态劣势,只能靠性能、能效、成本上的显著优势来抵消迁移成本。王博给客户的下一阶段承诺是“5倍性价比”:把采购、运维和性能整体算进来,让不转平台显得更亏。这会提高对架构、互联、存储、系统设计每一层的要求,但也会提高中国算力发展的天花板。

第二,要在非GPU赛道上尽快走完从“单点突破”到“系统方案”的闭环。可重构不是一颗孤立芯片,它要和3D存储、Chiplet、晶圆级架构等前沿方向咬合,形成一棵有延展性的技术树。清微规划中的TX83,就尝试把可重构算力网格与晶圆级芯片结合,为“后GPU时代”的大规模集群预留试验场。

第三,要承认算力问题已从芯片问题升级为系统问题。在大规模推理场景下,算力产业需要可长期演进的整体,支撑应用。此时,如果基座完全由海外产品来搭建,我们的应用将进一步形成依赖。而清微智能则在押一条未来十年中国算力不再完全锁死在GPU帝国里的技术路线。

这条路当然不保证成功,GPU也不会被“第二阵营”颠覆。但从产业角度,它至少已留下两个里程碑:

一是把中国在新一代算力架构上的时间点,第一次对齐到全球同一批玩家。

王博曾经总结过,芯片技术发展有一个“类摩尔定律”:20年,架构更新一次。过去在CPU、GPU、存储、接口标准上,我们几乎总是在别人定完方向后才开始追;这一次,在TPU、LPU刚刚从论文走向产品的时间窗口,RPU也由中国工程师以同样节奏做成了可出货的工业品。

二是让国家层面在算力上多了一条真正可选之路。当GPU供应出现风险、单一生态的议价能力高得离谱时,已经被初步跑通的新架构,会成为“火种”。

把视角再拉远一点,如果未来十年AI真能避开上一轮“寒冬”的命运,很可能不是因为模型的聪明颠覆了人类想象,而是低成本大规模应用改变了人类的生产方式。在如此宏大的时代旋律中,站在中国产业的支流上,机会也是无限的。清微智能被时代赋予的稀缺性,最终将以算力红利的形式,反哺于中国产业。

来源:松果财经